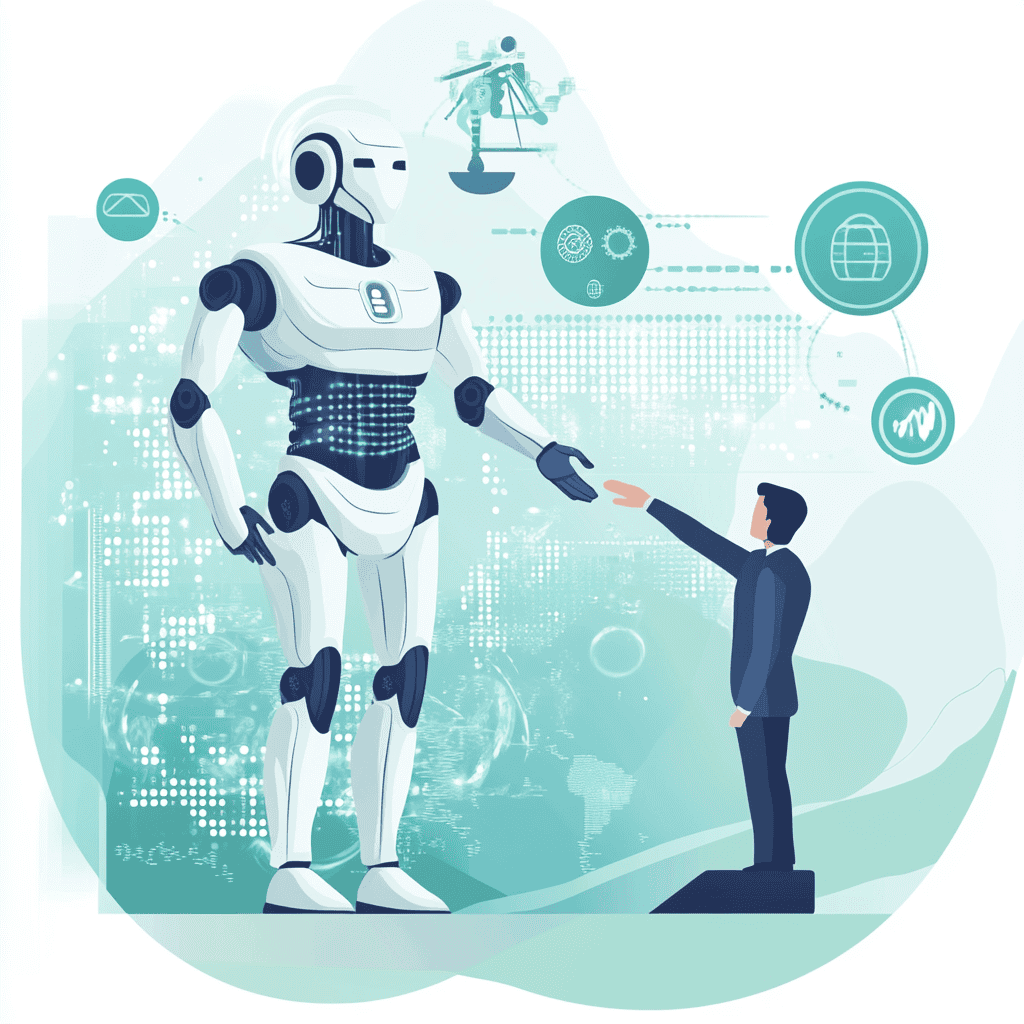

ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) กำลังก้าวหน้าอย่างรวดเร็วและมีบทบาทสำคัญในหลากหลายแง่มุมของชีวิตเรา แนวคิดเรื่อง Responsible AI หรือปัญญาประดิษฐ์ที่มีความรับผิดชอบ จึงเป็นประเด็นที่ได้รับความสนใจมากขึ้นเรื่อย ๆ แต่ Responsible AI คืออะไร และทำไมจึงมีความสำคัญ ? บทความนี้จะพาคุณไปทำความรู้จักกับแนวคิดนี้อย่างละเอียด

Responsible AI คืออะไร?

Responsible AI หมายถึงแนวทางในการพัฒนา ใช้งาน และกำกับดูแลเทคโนโลยี AI ที่คำนึงถึงผลกระทบทางจริยธรรม สังคม และกฎหมาย โดยมุ่งเน้นให้ AI สร้างประโยชน์สูงสุดแก่มนุษย์และสังคม ขณะเดียวกันก็ลดความเสี่ยงและผลกระทบเชิงลบที่อาจเกิดขึ้น

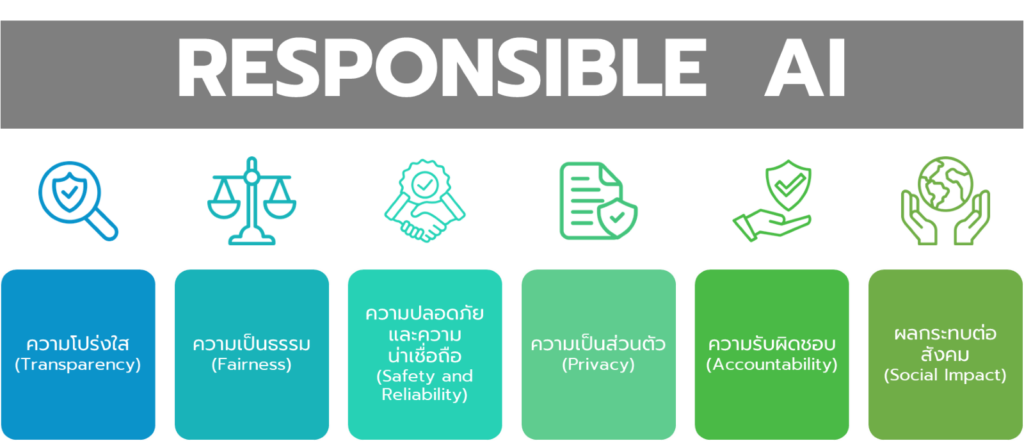

หลักการสำคัญของ Responsible AI

1. ความโปร่งใส (Transparency): ระบบ AI ควรสามารถอธิบายกระบวนการตัดสินใจได้ เพื่อให้ผู้ใช้เข้าใจและตรวจสอบได้

2. ความเป็นธรรม (Fairness): ลดอคติและการเลือกปฏิบัติในการทำงานของ AI เพื่อให้มั่นใจว่าทุกคนได้รับการปฏิบัติอย่างเท่าเทียม

3. ความปลอดภัยและความน่าเชื่อถือ (Safety and Reliability): AI ต้องทำงานอย่างปลอดภัยและเชื่อถือได้ โดยมีการทดสอบและตรวจสอบอย่างรัดกุม

4. ความเป็นส่วนตัว (Privacy): ปกป้องข้อมูลส่วนบุคคลของผู้ใช้และเคารพสิทธิความเป็นส่วนตัว

5. ความรับผิดชอบ (Accountability): มีกลไกรับผิดชอบเมื่อเกิดปัญหาจากการใช้ AI และมีการกำหนดผู้รับผิดชอบอย่างชัดเจน

6. ผลกระทบต่อสังคม (Social Impact): พิจารณาผลกระทบในวงกว้างต่อสังคม เศรษฐกิจ และสิ่งแวดล้อม

Responsible AI เป็นแนวคิดสำคัญในการพัฒนาและใช้งานปัญญาประดิษฐ์อย่างมีความรับผิดชอบ โดยมุ่งเน้นการสร้างความไว้วางใจ ลดความเสี่ยง และส่งเสริมนวัตกรรมที่เป็นประโยชน์ต่อสังคม ขณะเดียวกันก็เตรียมพร้อมรับมือกับกฎระเบียบที่อาจเกิดขึ้นในอนาคต อย่างไรก็ตาม การนำ Responsible AI ไปปฏิบัติยังคงมีความท้าทายหลายประการ ทั้งในแง่ของความซับซ้อนของเทคโนโลยี การสร้างสมดุลระหว่างนวัตกรรมและความรับผิดชอบ ความแตกต่างทางวัฒนธรรม และการวัดผลความสำเร็จ การตระหนักถึงความสำคัญและความท้าทายเหล่านี้จะช่วยให้องค์กรและผู้พัฒนาสามารถก้าวไปข้างหน้าในการสร้างระบบ AI ที่มีประสิทธิภาพและรับผิดชอบต่อสังคมได้อย่างยั่งยืน

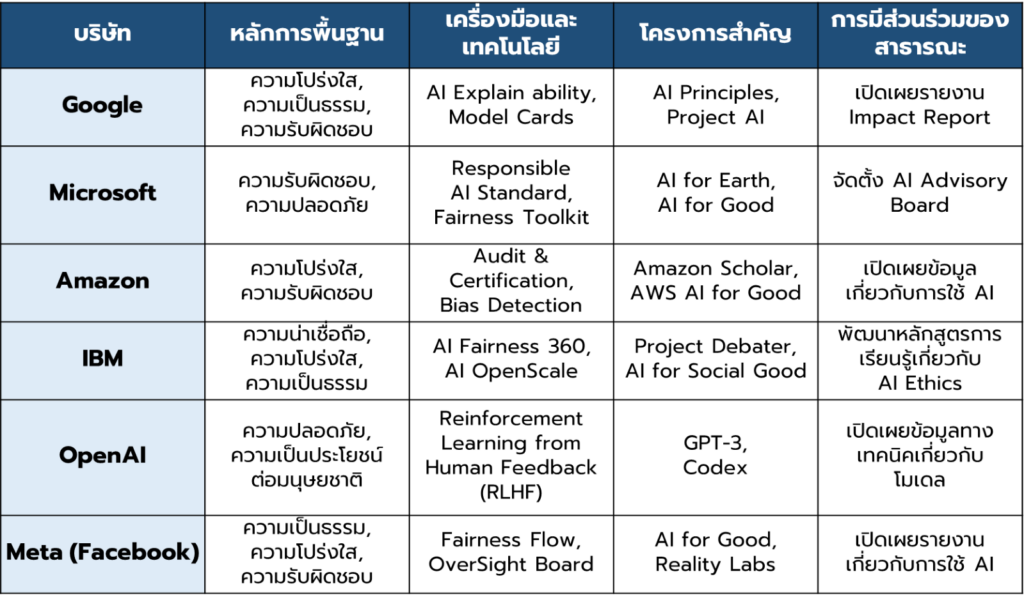

แนวทาง Responsible AI ของบริษัทเทคโนโลยีชั้นนำ

เพื่อให้เห็นภาพที่ชัดเจนขึ้นว่า Responsible AI ถูกนำไปปฏิบัติอย่างไรในโลกธุรกิจ เรามาดูการเปรียบเทียบแนวทางของบริษัทยักษ์ใหญ่ด้านเทคโนโลยี ได้แก่ Google, Microsoft, Amazon, IBM, OpenAI และ Facebook ดังตาราง

Google: ให้ความสำคัญกับความโปร่งใสและความเป็นธรรมใน AI เป็นอย่างมาก โดยมีหลักการ AI ที่ชัดเจนและเครื่องมืออย่าง AI Explainability เพื่อให้ผู้ใช้เข้าใจการทำงานของโมเดล AI ได้ดีขึ้น นอกจากนี้ Google ยังมีโครงการต่างๆ เช่น Project AI ที่มุ่งเน้นการพัฒนา AI ที่เป็นประโยชน์ต่อสังคม

Microsoft: เน้นย้ำถึงความรับผิดชอบและความปลอดภัยในการพัฒนา AI โดยมี Responsible AI Standard เป็นแนวทางในการพัฒนาผลิตภัณฑ์ AI ทั้งหมด นอกจากนี้ Microsoft ยังมีโครงการ AI for Earth และ AI for Good ที่มุ่งใช้ AI แก้ปัญหาสิ่งแวดล้อมและสังคม

Amazon: ให้ความสำคัญกับความโปร่งใสและความรับผิดชอบในการใช้ AI โดยมีเครื่องมือตรวจจับอคติและกระบวนการตรวจสอบที่เข้มงวด นอกจากนี้ Amazon ยังสนับสนุนการวิจัยด้าน AI ผ่านโครงการ Amazon Scholar และนำ AI มาใช้เพื่อพัฒนาผลิตภัณฑ์และบริการต่างๆ

IBM: เน้นย้ำถึงความน่าเชื่อถือ ความโปร่งใส และความเป็นธรรมในการพัฒนา AI โดยมีเครื่องมืออย่าง AI Fairness 360 และ AI OpenScale เพื่อช่วยให้นักพัฒนาสร้างโมเดล AI ที่เป็นธรรมและโปร่งใส นอกจากนี้ IBM ยังมีโครงการ Project Debater ที่พัฒนา AI เพื่อโต้แย้งกับมนุษย์

OpenAI: เน้นย้ำถึงความปลอดภัยและประโยชน์ต่อมนุษยชาติในการพัฒนา AI โดยใช้เทคนิค Reinforcement Learning from Human Feedback (RLHF) เพื่อฝึกสอนโมเดล AI ให้เป็นไปตามค่าที่มนุษย์ต้องการ นอกจากนี้ OpenAI ยังเปิดเผยข้อมูลทางเทคนิคเกี่ยวกับโมเดล AI เพื่อส่งเสริมความโปร่งใส

Meta (Facebook): เน้นย้ำถึงความเป็นธรรม ความโปร่งใส และความรับผิดชอบในการพัฒนา AI โดยมีเครื่องมือ Fairness Flow เพื่อช่วยให้นักพัฒนาตรวจสอบและแก้ไขปัญหาอคติในโมเดล AI นอกจากนี้ Meta ยังมี Oversight Board เพื่อตรวจสอบการตัดสินใจที่สำคัญของบริษัทเกี่ยวกับเนื้อหาบนแพลตฟอร์ม

บริษัทเทคโนโลยีชั้นนำเหล่านี้ต่างให้ความสำคัญกับการพัฒนา AI อย่างรับผิดชอบ โดยมีแนวทางและเครื่องมือที่หลากหลายเพื่อช่วยให้มั่นใจว่า AI จะถูกนำมาใช้ในทางที่ดีและเป็นประโยชน์ต่อสังคม

แนวทาง Responsible AI ของหน่วยงานภาครัฐในประเทศไทย

สำหรับประเทศไทย แม้จะยังไม่มีกรอบการทำงานหรือแนวทางปฏิบัติด้าน Responsible AI ที่เป็นทางการ แต่ก็มีความพยายามในการพัฒนาในด้านนี้ สรุปสถานการณ์ปัจจุบันของไทยได้ดังนี้:

1. ยุทธศาสตร์ปัญญาประดิษฐ์แห่งชาติ:

กระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม (MDES) ได้จัดทำ “ยุทธศาสตร์ปัญญาประดิษฐ์แห่งชาติ” ซึ่งมีการกล่าวถึงประเด็นด้านจริยธรรมและความรับผิดชอบในการพัฒนาและใช้งาน AI โดยหลักการสำคัญที่สะท้อนถึงแนวคิด Responsible AI ในยุทธศาสตร์ฯ ได้แก่

การพัฒนาอย่างยั่งยืน: เน้นการนำ AI มาใช้เพื่อแก้ไขปัญหาสังคมและเศรษฐกิจอย่างยั่งยืน โดยคำนึงถึงผลกระทบในระยะยาวต่อสิ่งแวดล้อมและสังคม

ความโปร่งใส: การพัฒนาและใช้งาน AI ต้องมีความโปร่งใส สามารถตรวจสอบได้ และสามารถอธิบายได้ว่า AI ทำงานอย่างไร

ความเป็นธรรม: การออกแบบและพัฒนา AI ต้องปราศจากอคติ และไม่ก่อให้เกิดความไม่เท่าเทียม

ความปลอดภัย: การพัฒนาและใช้งาน AI ต้องมีความปลอดภัย ไม่ก่อให้เกิดอันตรายต่อบุคคลหรือทรัพย์สิน

ความรับผิดชอบ: ผู้พัฒนาและผู้ใช้งาน AI ต้องมีความรับผิดชอบต่อผลกระทบที่เกิดจากการใช้งาน AI

2. แนวปฏิบัติจริยธรรมปัญญาประดิษฐ์ ของ ETDA:

แนวปฏิบัติจริยธรรมปัญญาประดิษฐ์ หรือ AI Ethics Guideline ที่จัดทำโดยสำนักงานพัฒนาวิทยาศาสตร์และเทคโนโลยีแห่งชาติ (สพธอ.) หรือ ETDA นั้น ถือเป็นเอกสารสำคัญที่ให้แนวทางในการพัฒนาและใช้งานปัญญาประดิษฐ์อย่างมีความรับผิดชอบในประเทศไทย แนวคิดหลักของ Responsible AI ที่สะท้อนออกมาในเอกสารฉบับนี้มีดังนี้

ความโปร่งใส: ระบบ AI ควรสามารถอธิบายได้ว่าการตัดสินใจเกิดขึ้นได้อย่างไร เพื่อให้ผู้ใช้งานเข้าใจและไว้วางใจ

ความเป็นธรรม: AI ควรได้รับการออกแบบและพัฒนาเพื่อหลีกเลี่ยงอคติและความไม่เท่าเทียม

ความรับผิดชอบ: ผู้พัฒนา ผู้ใช้งาน และองค์กรที่เกี่ยวข้องกับ AI ควรรับผิดชอบต่อผลกระทบที่เกิดจากการใช้งาน AI

ความปลอดภัย: ระบบ AI ควรได้รับการออกแบบและพัฒนาเพื่อความปลอดภัย ไม่ก่อให้เกิดอันตรายต่อบุคคลหรือทรัพย์สิน

ความเป็นส่วนตัว: การเก็บรวบรวมและใช้งานข้อมูลส่วนบุคคลต้องเป็นไปตามกฎหมายและได้รับความยินยอมจากเจ้าของข้อมูล

ความยั่งยืน: การพัฒนาและใช้งาน AI ควรคำนึงถึงผลกระทบในระยะยาวต่อสังคมและสิ่งแวดล้อม

นอกจากหลักการพื้นฐานแล้ว แนวทางของ ETDA ยังให้รายละเอียดเกี่ยวกับการปฏิบัติที่เป็นรูปธรรม เช่น

การสร้างคณะกรรมการจริยธรรม: องค์กรควรมีคณะกรรมการที่รับผิดชอบในการกำกับดูแลและตรวจสอบการพัฒนาและใช้งาน AI

การให้ความสำคัญกับสิทธิมนุษยชน: การพัฒนา AI ควรคำนึงถึงสิทธิมนุษยชนเป็นสำคัญ

การสร้างความตระหนัก: สร้างความเข้าใจเกี่ยวกับ AI และผลกระทบของ AI ให้กับบุคลากรและสังคม

การร่วมมือกับภาคส่วนต่างๆ: ร่วมมือกับภาครัฐ ภาคเอกชน และภาคประชาสังคมในการพัฒนาและกำหนดนโยบายเกี่ยวกับ AI

ความท้าทายและโอกาสสำหรับประเทศไทย:

จะเห็นได้ว่าหน่วยงานภาครัฐของประเทศไทยก็ยังให้ความสำคัญและพยายามเป็นอย่างยิ่งที่จะพัฒนาแผนเพื่อรองรับ Responsible AI ซึ่งยังต้องอาศัยองค์ความรู้และความร่วมมือจากทุกภาคส่วนโดยมีแนวทางดังต่อไปนี้

1. การพัฒนากรอบการทำงานที่ครอบคลุม: ไทยยังต้องพัฒนากรอบการทำงานด้าน Responsible AI ที่ครอบคลุมและเป็นรูปธรรมมากขึ้น

2. การบูรณาการระหว่างหน่วยงาน: ต้องมีการประสานงานระหว่างหน่วยงานภาครัฐ ภาคเอกชน และภาคการศึกษาให้มากขึ้น

3. การสร้างความตระหนักรู้: ต้องมีการให้ความรู้และสร้างความตระหนักเกี่ยวกับ Responsible AI ในวงกว้าง

4. การปรับใช้ให้เหมาะสมกับบริบทไทย: ต้องพิจารณาบริบททางสังคม วัฒนธรรม และเศรษฐกิจของไทยในการพัฒนาแนวทาง Responsible AI

5. การพัฒนากฎหมายและกฎระเบียบ: อาจต้องมีการพัฒนากฎหมายหรือกฎระเบียบที่เกี่ยวข้องกับ AI เพื่อรองรับการพัฒนาและการใช้งานอย่างมีความรับผิดชอบแม้ว่าประเทศไทยจะยังอยู่ในช่วงเริ่มต้นของการพัฒนาแนวทาง Responsible AI แต่ก็มีความตื่นตัวและความพยายามจากหลายภาคส่วน ซึ่งเป็นสัญญาณที่ดีสำหรับการพัฒนาในอนาคต การศึกษาและปรับใช้แนวทางจากต่างประเทศ ควบคู่ไปกับการพัฒนาแนวทางที่เหมาะสมกับบริบทของไทย จะเป็นกุญแจสำคัญในการส่งเสริม Responsible AI ในประเทศไทยต่อไป

บทสรุป

Responsible AI ไม่ใช่เพียงแนวคิดเชิงทฤษฎี แต่เป็นแนวทางปฏิบัติที่จำเป็นในยุคที่ AI มีบทบาทสำคัญในชีวิตประจำวันของเรา การพัฒนาและใช้งาน AI อย่างมีความรับผิดชอบไม่เพียงแต่จะช่วยลดความเสี่ยงและผลกระทบเชิงลบ แต่ยังเป็นการสร้างรากฐานสำหรับการพัฒนาเทคโนโลยีที่ยั่งยืนและเป็นประโยชน์ต่อมนุษยชาติในระยะยาว ดังนั้น ทุกภาคส่วน ไม่ว่าจะเป็นภาครัฐ ภาคเอกชน นักวิจัย และประชาชนทั่วไป ล้วนมีบทบาทสำคัญในการส่งเสริมและสนับสนุนแนวคิด Responsible AI เพื่อสร้างอนาคตที่ AI และมนุษย์สามารถอยู่ร่วมกันได้อย่างสร้างสรรค์และยั่งยืน

บทความโดย ปริสุทธิ์ จิตต์ภักดี

ตรวจทานและปรับปรุงโดย นววิทย์ พงศ์อนันต์

แหล่งอ้างอิง

1. Bostrom, N., & Yudkowsky, E. (2014). The Ethics of Artificial Intelligence. In K. Frankish & W. M. Ramsey (Eds.), The Cambridge Handbook of Artificial Intelligence (pp. 316-334). Cambridge University Press. https://doi.org/10.1017/CBO9781139046855.020

2. European Commission’s High-Level Expert Group on AI. (2019). Ethics Guidelines for Trustworthy AI. Retrieved from https://digital-strategy.ec.europa.eu/en/library/ethics-guidelines-trustworthy-ai

3. The IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems. (n.d.). AI Ethics: Global Perspectives. Retrieved from https://ethicsinaction.ieee.org/

4. Google AI. (n.d.). Responsible AI Practices. Retrieved from https://ai.google/responsibilities/responsible-ai-practices/

5. Google. (n.d.). AI Principles. Retrieved from https://ai.google/responsibility/principles/

6. Google. (n.d.). Project AI. Retrieved from https://blog.google/technology/ai/

7. Microsoft. (2019). Responsible AI: A Framework for Building Trust in AI Systems. Retrieved from https://www.microsoft.com/en-us/ai/responsible-ai

8. Microsoft. (n.d.). Responsible AI Standard. Retrieved from https://www.microsoft.com/en-us/ai/responsible-ai

9. Microsoft Research. (n.d.). Fairlearn: A toolkit for assessing and improving fairness in AI. Retrieved from https://www.microsoft.com/en-us/research/publication/fairlearn-a-toolkit-for-assessing-and-improving-fairness-in-ai/

10. Microsoft. (n.d.). AI for Earth. Retrieved from https://news.microsoft.com/apac/features/ai-for-earth-helping-save-the-planet-with-data-science/

11. Microsoft Research. (n.d.). AI for Good Research Lab. Retrieved from https://www.microsoft.com/en-us/research/group/ai-for-good-research-lab/

12. Amazon Web Services. (n.d.). AWS AI for Good. Retrieved from https://aws.amazon.com/ai/

13. IBM Research. (n.d.). AI Fairness 360. Retrieved from https://aif360.res.ibm.com/

14. IBM. (n.d.). Manage AI models with IBM Watson OpenScale. Retrieved from https://mediacenter.ibm.com/media/Manage+AI+models+with+IBM+Watson+OpenScale/1_lqiuc2uq

15. IBM. (n.d.). Project Debater. Retrieved from https://opentodebate.org/debaters/ibm-project-debater/

16. IBM. (n.d.). AI for Social Good. Retrieved from https://www.ibm.com/watson/social-impact

17. OpenAI. (n.d.). Reinforcement Learning from Human Feedback (RLHF). Retrieved from https://openai.com/index/learning-from-human-preferences/

18. OpenAI. (n.d.). GPT-3. Retrieved from https://openai.com/index/gpt-3-apps/

19. Meta AI. (n.d.). How we’re using Fairness Flow to help build AI that works better for everyone. Retrieved from https://ai.meta.com/blog/how-were-using-fairness-flow-to-help-build-ai-that-works-better-for-everyone/

20. Meta. (n.d.). Oversight Board. Retrieved from https://www.oversightboard.com/

21. Meta AI. (n.d.). AI for Good. Retrieved from https://ai.meta.com/meta-ai/

22. Meta. (n.d.). Reality Labs. Retrieved from https://about.meta.com/realitylabs/

23. กระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม (MDES). (2564). ยุทธศาสตร์ปัญญาประดิษฐ์แห่งชาติ. สืบค้นจาก https://www.mdes.go.th/policy/5179

24. สำนักงานพัฒนาธุรกรรมทางอิเล็กทรอนิกส์ (ETDA). (2565). แนวปฏิบัติจริยธรรมปัญญาประดิษฐ์. สืบค้นจาก https://www.etda.or.th/getattachment/9d370f25-f37a-4b7c-b661-48d2d730651d/Digital-Thailand-AI-Ethics-Principle-and-Guideline.pdf.aspx?lang=th-TH

Data Management Training and Development Manager at Big Data Institute (Public Organization), BDI

- Parisut Jitpakdee, PhDhttps://temp.bdi.or.th/en/author/parisut/31 March 2025

- Parisut Jitpakdee, PhDhttps://temp.bdi.or.th/en/author/parisut/

- Parisut Jitpakdee, PhDhttps://temp.bdi.or.th/en/author/parisut/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/