ความซื่อสัตย์เป็นนโยบายที่สำคัญที่สุด และกับปัญญาประดิษฐ์ก็เป็นจริงตามนั้นด้วยเช่นกัน ดังนั้นเรานำความรู้เรื่องจริยธรรม AI มาฝากกัน ( AI จริยธรรม )

AI หรือปัญญาประดิษฐ์ กำลังเปลี่ยนแปลงวิธีการทำงานขององค์กรและการมีส่วนร่วมของผู้คน เทคโนโลยีนี้ช่วยเพิ่มความสามารถในการทำงานที่ง่ายและซ้ำ ๆ ได้โดยอัตโนมัติ ปลดล็อกข้อมูลเชิงลึกที่ซ่อนอยู่ภายใต้ข้อมูลอีกที และช่วยให้เราตัดสินใจได้ดียิ่งขึ้น และมีข้อมูลมากขึ้น แต่ในวันที่ AI ได้เริ่มฝังรากลึกลงในกระแสหลักของไอที ความกังวลที่จะใช้ AI ไปในทางที่ผิดก็มีเพิ่มมากขึ้นเช่นกัน

เพื่อแก้ไขปัญหาทางจริยธรรมที่อาจเกิดขึ้นซึ่งเป็นการวิเคราะห์ข้อมูลและการตัดสินใจที่ไม่ได้มาจากมนุษย์เอง มีองค์กรจำนวนมากเริ่มหันมาให้ความสนใจว่าเราจะสามารถป้องกันไม่ให้ AI ทำการตัดสินใจที่อาจเป็นอันตรายได้หรือไม่ อย่างไร

AI เป็นเทคโนโลยีที่ทรงพลังและมีคุณประโยชน์มากมายมหาศาล Francesca Rossi หัวหน้าหน่วยด้านจริยธรรม AI ของ IBM กล่าวว่า “อย่างไรก็ตาม เพื่อวัดผลประโยชน์ที่เป็นไปได้อย่างเต็มที่ เราต้องสร้างระบบที่ไว้วางใจได้ ทั้งในเทคโนโลยีและในตัวผู้ผลิตเอง” “ปัญหาอคติ การอธิบายตัวข้อมูล การจัดการข้อมูล ความโปร่งใสในนโยบายของข้อมูล ความสามารถของระบบ และการออกแบบควรได้รับการแก้ไข มีผู้รับผิดชอบ และต้องเปิดเผย”

Olivia Gambelin นักจริยธรรม AI และ CEO ของบริษัทที่ปรึกษาด้านจริยธรรม Ethical Intelligence อธิบายว่า “เรื่องจริยธรรมของ AI ควรมุ่งเน้นไปที่การทำความเข้าใจผลกระทบของ AI ที่มีต่อสังคม แล้วหาวิธีลดผลกระทบที่เกิดขึ้นนั้น และควรต้องคิดถึงการขับเคลื่อนนวัตกรรมระดับสากลเพื่อไปสู่สิ่งที่ดีกว่าด้วย” การปฏิบัติตามหลักจรรยาบรรณของ AI นั้น ขึ้นอยู่ที่ว่าเราแปลความหมายของหลักการเหล่านั้น ออกมาเป็นการกระทำที่เป็นรูปธรรมอย่างไร มีรายละเอียดแบบไหน และเราพยายามที่จะใช้เทคโนโลยีโดยคำนึงไปที่คุณค่าของมนุษย์เป็นหลักหรือไม่” เธอกล่าว

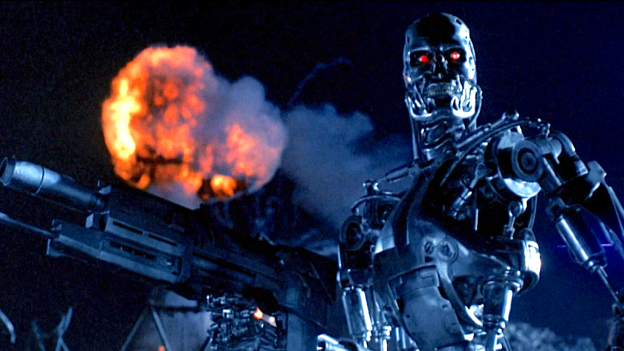

โซนอันตรายของปัญญาประดิษฐ์

“มีวิธีนับไม่ถ้วนที่จะใช้ AI ไปในทางที่ผิด และหลายๆ วิธีก็ได้เกิดขึ้นแล้วด้วย” Kentaro Toyama ศาสตราจารย์ด้านข้อมูลชุมชนของ W.K. Kellogg แห่ง University of Michigan School of Information กล่าว

“โดรนทหารตัดสินใจสังหารคน โดยใช้ AI ในการตัดสินใจการกระทำนั้น เทคโนโลยี Deepfake ที่ถูกนำมาใช้กับการโกหกแบบซึ่ง ๆ หน้า หรือแม้แต่บริษัทต่าง ๆ ที่อ้างถึงการซื้อขายตามการอนุมานของ AI เพื่อผลประโยชน์เชิงพาณิชย์”

Toyama ตั้งคำถามประเด็นร้อนอีกประเด็นหนึ่งเกี่ยวกับจริยธรรม AI ในปัจจุบันถึง “ความเป็นธรรมของอัลกอริทึม (algorithmic fairness)” เขากล่าว “เราจะมั่นใจได้อย่างไรว่าระบบดิจิทัลจะไม่ลำเอียงไปที่กลุ่มใดกลุ่มหนึ่ง โดยอิงจากเชื้อชาติ เพศ หรือความเป็นตัวตนอื่น ๆ ”

AI อยู่รอบตัวเราเต็มไปหมด มันกำลังมุ่งหน้าสร้างความจริงอันสมบูรณ์แบบ โดยอาศัยโมเดล Machine Learning ที่อาจจะถูกสร้างแบบรีบ ๆ และถูกใช้อย่างเร่งด่วนเพื่อตอบสนองตามวัตถุประสงค์เจาะจงบางอย่างทางธุรกิจก็เป็นได้ AI แบบนี้ที่จริงอาจเป็นเพียงแค่ค่าใช้จ่ายเพื่อสร้างผลกระทบกับกลุ่มลูกค้าที่แตกต่างกันออกไปเท่านั้น

Scott Zoldi หัวหน้าเจ้าหน้าที่วิเคราะห์ของ FICO บริษัทที่เชี่ยวชาญด้านบริการให้คะแนนเครดิตกล่าวว่า “ความลึกลับของโมเดล Machine Learning ส่งผลให้ผู้ใช้ทางธุรกิจเหล่านี้กลายเป็นคนประมาทและไม่สนเรื่องจริยธรรม พวกเขาแทบจะไม่ได้ติดตามผลหรือตั้งคำถามเรื่องที่ AI ทำลงไปด้วยซ้ำ”

ความกังวลอีกประการหนึ่งคือ ระบบ AI มีแนวโน้มในการทำงานได้ดีเมื่อเจอกับข้อมูลที่เคยได้รับมาหรือถูกฝึกมาก่อน แต่เมื่อมันเจอกับข้อมูลใหม่ ๆ จากโลกแห่งความเป็นจริง AI มักทำงานได้ไม่ดีนัก (เนื่องจากรูปแบบการสร้าง AI ที่นิยมคือการป้อนข้อมูลตัวอย่างจำนวนมากให้ AI เพื่อเป็นการฝึกว่าหากเจอแต่ละตัวอย่าง AI ควรทำอย่างไร และเมื่อมีข้อมูลคล้าย ๆ กันมากพอ ก็จะช่วยในการตัดสินใจและปฏิบัติได้ดี แต่ในทางกลับกัน หาก AI เจออะไรใหม่ ๆ ก็อาจส่งผลให้ AI ทำได้ไม่ดีเท่าที่ควร)

Lama Nachman ผู้อำนวยการห้องปฏิบัติการระบบอัจฉริยะของ Intel กล่าว “สิ่งนี้ทำให้เกิดข้อกังวลด้านความปลอดภัยบางอย่าง เช่น ยานยนต์อัตโนมัติ อาจตัดสินใจกระทำบางอย่างไม่ถูกต้องหากเจอเหตุการณ์ที่ไม่ปกติ หรือไม่เคยเจอมาก่อน” เธอตั้งข้อสังเกต “นั่นจึงจำเป็นอย่างยิ่งที่ระบบ AI เหล่านี้ ต้องมีการกำกับดูแลและติดตามเพื่อให้แน่ใจว่าจะไม่ทำอะไรผิดพลาด เมื่อเวลาผ่านไป”

การจัดการกับเรื่องจริยธรรม AI

นโยบายจริยธรรมของ AI เป็นชุดของหลักการและแนวทางปฏิบัติซึ่งออกแบบมาเพื่อพัฒนาและปรับใช้เทคโนโลยี AI ขององค์กร Nachman กล่าวว่า “โดยทั่วไปแล้วจริยธรรม AI จะขึ้นอยู่กับแนวทางการวิเคราะห์ความเสี่ยง ซึ่งผู้ที่เกี่ยวข้อง ไม่ว่าจะเป็นผู้พัฒนา ผู้ขาย หรือผู้ใช้งานระบบเหล่านี้ ก็ควรร่วมช่วยกันประเมินความเสี่ยงซึ่งเกี่ยวข้องกับเทคโนโลยี AI ที่อาจเป็นไปได้ โดยทั่วไปแล้วหลักจริยธรรมของ AI จะรวมถึงประเด็นต่าง ๆ เช่น ความเป็นธรรม ความโปร่งใส ความเป็นส่วนตัว ความปลอดภัย ความรับผิดชอบ และการกำกับดูแลของมนุษย์” เธอกล่าวเสริม

และด้วยกฎข้อบังคับ AI ที่เพิ่มขึ้น ยังส่งผลกระทบให้มีการทบทวนเรื่อง AI อย่างหนัก ซึ่งส่งผลกระทบความต้องการของตลาดในความก้าวหน้าของเทคโนโลยีแบบมีความรับผิดชอบ ดังนั้นนโยบายจริยธรรม AI จึงไม่ได้เป็นทางเลือกที่ควรมี แต่เป็นทางรอดที่จำเป็นอย่างยิ่ง Gambelin กล่าว “การใช้จริยธรรมเป็นเครื่องมือในการตัดสินใจที่สำคัญ ดังนั้นบริษัทที่ขับเคลื่อนด้วย AI สามารถช่วยประหยัดเวลาและเงินในระยะยาวด้วยการสร้างโซลูชันที่แข็งแกร่งและเป็นนวัตกรรมใหม่ที่ดีได้ตั้งแต่ต้น”

แนวโน้มจริยธรรม AI

องค์กรที่พัฒนาเทคโนโลยี AI ควรเริ่มพิจารณาประเด็นด้านจริยธรรมตั้งแต่เริ่มต้นโครงการ Anand Rao หัวหน้าฝ่าย AI ระดับโลกของบริษัทที่ปรึกษาธุรกิจ PwC กล่าว “จริยธรรมไม่สามารถเป็นเพียงช่องตัวเลือกที่สามารถติ๊กเครื่องหมายถูกเพื่อเปิดใช้งานเมื่อสิ้นสุดการเปิดตัวผลิตภัณฑ์ พวกเขาต้องออกแบบผลิตภัณฑ์ด้วยแนวคิดที่มีจริยธรรมตั้งแต่ต้น” เขากล่าว

จากการวิจัยของ PwC ในปี 2021 มีเพียง 20% ขององค์กรที่มีกรอบจริยธรรมด้าน AI และมีเพียง 35% เท่านั้นที่มีแผนจะปรับปรุงการกำกับดูแลระบบและกระบวนการ AI “อย่างไรก็ตาม เนื่องจาก AI ที่มีความรับผิดชอบเป็น AI อันดับต้น ๆ สำหรับผู้บริหารในปี 2021 ฉันหวังว่าเราจะเห็นตัวเลขที่ดีขึ้นในปีนี้” Rao กล่าว

ผู้นำธุรกิจและไอทีต้องปฏิบัติตามแนวทางองค์รวม สหวิทยาการ รวมถึงผู้มีส่วนได้ส่วนเสียหลายฝ่าย ทั้งนี้ก็เพื่อสร้างความไว้วางใจด้าน AI ให้มีขึ้นมาได้ ระบบความเชื่อถือควรตรวจสอบให้แน่ใจว่ามีการระบุปัญหา อภิปราย และแก้ไขในสภาพแวดล้อมแบบมีส่วนร่วม “นี่เป็นแนวทางแบบสหวิทยาการและแบบร่วมมือซึ่งจะสร้างการแก้ปัญหาที่ดีที่สุดและมีแนวโน้มที่จะนำไปสู่สภาพแวดล้อมที่ครอบคลุมและมีประสิทธิภาพสำหรับ AI ที่น่าเชื่อถือ” Rossi จาก IBM กล่าวา

Gambelin อธิบายจริยธรรมของ AI ด้วยการเปรียบเปรยว่า “มันคืออุตสาหกรรมที่ซับซ้อนอันสวยงาม เต็มไปด้วยบุคคลที่มีความกระตือรือร้น ในองค์กรที่เปี่ยมไปด้วยแรงบันดาลใจ” เธอตั้งข้อสังเกตเพิ่มว่าจริยธรรมของ AI นั้นกำลังอยู่ในช่วงวิกฤติ “ตอนนี้เป็นช่วงเวลาที่ไม่เคยมีมาก่อน ในฐานะมนุษย์เรามีโอกาสได้ไตร่ตรองถึงสิ่งที่เราต้องการได้รับจากเทคโนโลยีของเราอย่างแท้จริง และจริยธรรมจะเป็นเครื่องมือที่ช่วยให้เราสามารถนำความฝันและแรงบันดาลใจเหล่านี้ไปปฏิบัติได้”

บทความโดย John Edwards

เนื้อหาจากบทความของ InformationWeek

แปลและเรียบเรียงโดย วิน เวธิต

ตรวจทานและปรับปรุงโดย นววิทย์ พงศ์อนันต์

Position Technology Solution Principal, IT division

- Waythit Puangpakisirihttps://temp.bdi.or.th/en/author/win-waythit/

- Waythit Puangpakisirihttps://temp.bdi.or.th/en/author/win-waythit/12 November 2022

- Waythit Puangpakisirihttps://temp.bdi.or.th/en/author/win-waythit/12 November 2022

- Waythit Puangpakisirihttps://temp.bdi.or.th/en/author/win-waythit/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/30 August 2024

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/

- Navavit Pongananhttps://temp.bdi.or.th/en/author/gas/